メタデータ、医療・化粧品領域に特化した日本語LLMを自社開発

~ NVIDIA H200×8利用に、高速学習最適化で、特化LLMの開発コストを従来比「1桁以上」削減。製造・防衛など多業界向けに展開へ

メタデータ株式会社(所在地:東京都文京区、代表取締役社長:野村直之)は、このたび、OpenAI社 gpt-oss 系モデルをベースに、日本語の医療特化型LLMおよび化粧品領域特化型LLMの開発に成功したことを発表いたします。本成果は、NVIDIA H200 GPU×8構成を備えるハイレゾ株式会社のGPUクラウド「GPUSOROBAN」を活用し、継続事前学習(Continued Pretraining)と段階的ファインチューニング(SFT / Reinforcement Fine-Tuning)を最適化した結果得られたものです。医療特化型LLMでは学習前に解けなかった、日本の医師国家試験問題で正答できるようになっています。

今回の取り組みにより、昨年以前と比較して“1桁以上の低コスト”で高精度な特化型LLMが開発可能であることが実証されました。

これを受け、当社は 製造業、運輸・流通、公共、法律、防衛などの領域にも、特化型LLMの自社開発および受託開発を本格展開してまいります。

■ 日本語の医療特化型LLM開発のポイント

● Soroban(H200×8)による高速学習と安定した大規模計算

ハイレゾ株式会社より提供いただいた NVIDIA H200 GPU 8基構成ノードにより、

・数十〜百億トークン規模の日本語・英語混合コーパスでの継続事前学習

・医療推論向けSFT

・出力整形・一貫性向上のための強化学習(GRPO)

を、現実的な時間で反復可能な開発プロセスとして確立。

これにより、従来は数千万円級のGPU計算コストが必要だった特化LLM開発が、実用的な投資規模で可能になりました。

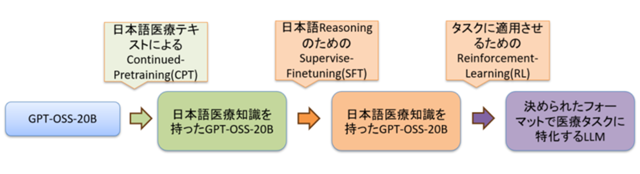

図 特化型LLM開発の流れ

● 開発の三段階プロセス

ステージ1: 日本語医療コーパスを用いた高品質な継続事前学習(Continued Pretraining)

医学・科学領域の英語論文(peS2o:76.4B tokens)を日本語に翻訳

- 日本語汎用コーパス(130.7B tokens)から 医療・科学要素を抽出し5Bに精選

- これらを組み合わせ、日本語医療文脈に強い基盤モデルを構築。

- これにより「医療文章を正しい前提で読み解くためのベース能力」を獲得。

ステージ 2: SFT (Supervised Fine Tuning) による臨床現場レベルの精度向上

SFT には英語医療推論データの日本語版(10k行)を使用し、日本語推論・説明力を強化。

「症状 → 鑑別 → 追加情報 → 最適解」という医療的な推論様式

を日本語で忠実に学ばせた。

この段階で、症例文の把握・所見の整理・選択肢の論理検討など、医師国家試験に必要な基礎推論力が大きく向上。

ステージ 3:GRPO による Reinforcement Learning で出力精度と一貫性を最適化

SFT だけでは取り切れない「出力形式の厳密性・一貫性」を補うため、GRPO(Group Relative Policy Optimization)による強化学習を追加実施。

報酬関数の3 要素:

- 指定フォーマット(Harmony形式)の遵守

- 医療ラベル・分類の正確性(正答ラベル一致)

- ラベル数一致

を総合し、この段階で、症例文の把握・所見の整理・選択肢の論理検討など、医師国家試験に必要な基礎推論力が大きく向上。特に、厳密なフォーマット出力が求められるタスクで高い安定性を発揮。実務運用可能な安定した医療応答品質を実現。

■化粧品LLMでも開発成功 — 口コミ・成分・功效説明へ特化

化粧品レビュー・専門説明データに基づき、

- 成分の作用機序

- 肌質適合性

- リスク情報

- 市場口コミ抽出や生成

へ最適化した日本語特化モデルも完成。

これにより、美容EC・化粧品メーカー・CS業務である程度活用できるレベルの対話・分析が可能となる見通しが得られました。

- 末尾の付録に、本学習後の入出力と、gpt-oss 20Bの素のままの出力の対比を掲載しています。

■ 今後の展開 — 多業界向け「特化型LLM×高精度RAG」の拡張

メタデータ社は、長年培った ChatBrid シリーズ(RAG高精度化技術) と組み合わせ、以下の分野に対し 特化LLM+RAG の導入支援・受託開発 を進めてまいります。

◆ 医療

- 医療向けRAG(ChatBrid)との統合による、安全で高精度な臨床支援AIの構築

- 医療教育向け・自学自習支援LLMの提供

- 病院・製薬企業・医療IT企業向けの特化LLM受託開発

◆ 製造業

- 故障予兆診断、保守マニュアル自動要約

- 図面・仕様書を含むマルチモーダルRAG

- 海外拠点向け多言語マニュアル生成

◆ 運輸・流通

- 配送計画・需要予測

- 安全運行ガイドラインの自動チェック

- ドライバー教育AI

◆ 公共(自治体・行政機関)

- 文書照会自動化

- 住民向けガイドラインQ&A

- 法令RAG × 文脈整合推論

◆ 法律

- 判例検索×RAG

- 条文生成・契約書レビュー

- 特定領域の専門対話LLM

◆ 防衛・危機管理

- マルチソースRAGによる高速意思決定支援

- 統合作戦手順書の即時照会

- 任務状況レポートの自動構造化

- 防衛知識の教育向け・自学自習支援環境をChatBridと共に提供

これら領域に共通するのは、“一般LLMでは出せない高い正確性・再現性” を求められる点です。今回の医療・化粧品モデル開発により、当社は 高精度特化LLMを短期間・低コストで構築できるノウハウ、体制を確立しました。

■ 野村代表のコメント

「特化型LLMの実用化コストが従来比で一桁以上下がりました。今回は、1TB級のGPUメモリと、学習用に最適化された高速演算性能をもった環境で2,3週間程度で完了しましたが、さらなる学習最適化によって、より小規模なハードウェアでも特化型LLMの開発が可能となります。

そして、出来上がった特化型LLMは、20B規模のため、MacBookなどの比較的安価なハードウェアで実行が可能となります。また、ChatBrid のRAG機能でも、影プロンプト作成の自動化の推進を進めていますが、今後、特化型LLMの併用で、RAGはメタ知識を中心に搭載し、目的や利用者に適合した回答の生成、問題解決ためのチューニングに、より注力できることが期待されます。

医療や化粧品に続き、製造・公共・法律・防衛など、日本の産業が抱える情報資産を“そ のままAIが読める形”にしていくことができます。ChatBridの高精度RAG技術と組み合わせることで、企業・行政の知識活用を飛躍的に進化させる基盤を、今後も自社開発・受託開発の両面で提供してまいります。」

■ メタデータ株式会社について

メタデータ株式会社は、RAG高精度化技術「ChatBrid」、オンプレ型RAG「ChatBrid OR」、

企業内ナレッジ活用AI、専門領域特化LLMなどを開発する日本のAI企業です。

独自の「多次元ベクトル検索」「データセットプロンプト」「重み付きマルチカラムRAG」を強みに、企業のナレッジ活用と安全なAI運用を支援しています。

付録 本学習後の入出力と、gpt-oss 20Bの素のままの出力の対比

例1:

・質問文:「肌のくすみが気になります。明るく見せてくれる下地はありますか?」

・学習後の回答:「明るさや透明感が気になる方には、下地の中でも「ピンクやローズ系の下地」がお勧めです。下地を使うことで肌に透明感を与えることができます。」

・学習前の崩れた回答:「まず、フレッシュがイタリズムであることに気づいてしまい、にって、みんなでいきる! オフィスで控えめに使える香水を選ぶ際は、香りが強すぎず、周囲の人に不快感を与えないものが理想です。一般的に、フレッシュで軽い香りは、ビジネスシーンで好まれます。 おすすめの香水は、フレッシュなノートを中心に配合された製品です。これらは、クリーンで清潔感のある香りを提供し、周囲の人の集中力を妨げにくいとされています。 また、香水を選ぶ際には、個人の体臭との相性や、アレルギーの有無も考慮してください。香水の選択肢を広げるために、デモやサンプルを試してみるのも一つの手です。 はい、わかりました! ありがとうございます。もし他に質問やお手伝いが必要なことがあれば、いつ」

例2:

・質問文:「オフィスでも浮かない控えめな香水を探しています。」

・学習後の回答:「柑橘系をベースに、バラやスズランなどのフラワリーを加えた柔らかな香りが、オフィスでのマナーに合う香りとしておすすめです。」

・学習前の崩れた回答:「**前回の同じ質問の前置き前置例として(あっくっかに・)にさっでいく前か? 以下のプラファウムのご質問を後にかつもきつく はい、以下はご先行前置まさっで We need to answer about underlayer that brightens dullness. The user wants to know “there is any base that can make skin look bright”. The answer: we can explain that there are various types of “foundation” etc, but caution not to use legal statements. We need to keep to the guidelines: no symbols like |, etc. No repetition. Use polite language. Avoid certain symbols like “。” or “、”? They said “avoid ‘|’ and ‘。” etc. They say not to include those. We must not use punctuation? That seems impossible. But maybe they want no punctuation? The instruction: “口語らしく柔らかな文体を用いる”. We can use sentences with no punctuation. Use no “。” etc. Just continuous text. It’s tough. We should comply: no “。”. We can use sentences separated by spaces. Use polite language. We can avoid punctuation by using line breaks